HOKUTO編集部

11ヶ月前

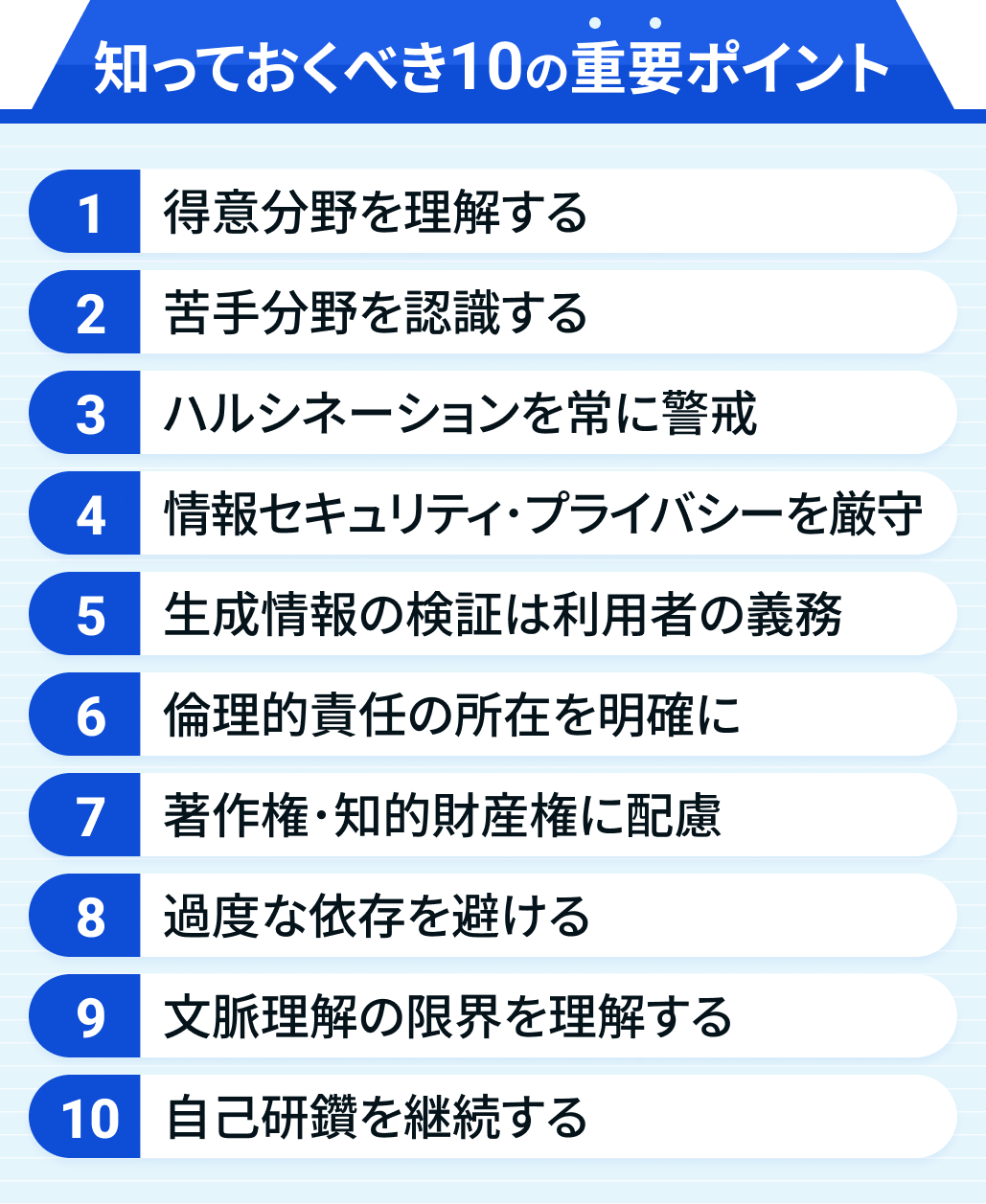

【新連載】ChatGPTを使う前に知っておきたい10のこと

生成AIの医療活用において、 トップランナーの一人である近畿大学医学部皮膚科学教室の大塚篤司先生による新連載がスタートします。 ChatGPTに興味はあるものの、 使いどころに迷っている医師に向けて、 明日から実践できる活用法をわかりやすく解説します!

はじめに

人工知能 (AI) 技術、 特にChatGPTのような大規模言語モデル (LLM) は医療分野でも注目されている。 本連載では、 医療従事者がChatGPTを安全かつ効果的に活用するために知っておくべきことを解説する。

第1回は総論として、 ChatGPTを効果的に使うために最低限知っておくべき10の重要ポイントを概説する。 この基本理解が、 適切な活用の第一歩である。

1. 得意分野を理解する

文章処理・情報整理・アイデア創出が得意

自然な文章生成、 校正、 要約、 情報整理、 多言語対応、 アイデア発想支援などを得意とする。 これらを活用すると、 業務効率化が図れる。

2. 苦手分野を認識する

最新情報・専門的判断には限界あり

ChatGPTの知識は学習時点までのものであり、 最新情報には対応していない。

また、 複雑な計算、 論理推論、 確定診断のような高度な専門的判断も不得手である。

3. ハルシネーションを常に警戒

ファクトチェックが不可欠

ChatGPTには、 事実と異なるもっともらしい虚偽情報を生成するリスク (ハルシネーション) がある。

ハルシネーションは、 正確性が求められる医学情報において特に危険であるため、 ファクトチェックが欠かせない。

4. 情報セキュリティ・プライバシーを厳守

個人情報・機密情報の入力は厳禁

ChatGPTに患者の個人情報や機密情報を入力することは、 情報管理上の重大なリスクであり厳禁である。 匿名化を徹底し、 施設のガイドラインを遵守する。

なお、 画面右上の一時チャットボタンを押すことで、 ChatGPTに内容を学習させないことができる。

(OpenAIのChatGPT画面より引用。 右上の 「一時」 をクリックすると 「一時チャット」 に切り替わる。 )

5. 生成情報の検証は利用者の義務

最終責任は利用者にあり

AIの生成情報を、 そのまま鵜呑みにしてはならない。 必ず自身の専門知識と信頼できる情報源 (PubMedなどのデータベース) で検証し、 最終的な判断と責任は利用者自身が負う。

6. 倫理的責任の所在を明確に

倫理的責任も利用者にあり

ChatGPTを医療に活用する際には、 倫理的観点の配慮も欠かせない。 AI利用に関する倫理的責任は、 AIではなく利用する医療従事者自身にあることを常に意識する。

7. 著作権・知的財産権に配慮

意図せず著作権侵害が起こることも

生成物が既存の著作物と類似する可能性もある。 意図しない著作権侵害を避けるため、 必要に応じて出典確認やオリジナリティの担保が必要である。

8. 過度な依存を避ける

使う側の 「思考」 を省略しない

AIはあくまで補助ツールである。 自分の頭を通らないクリックは、 思考や勉強ではなく単なる 「作業」 であることを肝に銘じる。

9. 文脈理解の限界を理解する

プロンプトの書き方が重要

長大な文脈や複雑なニュアンス、 暗黙の了解の完全な理解は難しい場合があるため、 プロンプト (指示) の書き方を工夫する必要がある。 詳細は次回以降に解説する。

10. 自己研鑽を継続する

進化するAIに対応できる力を磨く

AI技術は日進月歩である。 常に最新情報を学び、 自身の専門知識をアップデートし続けることで、 AIをより有効なパートナーとすることができる。

ChatGPTは、 本稿で挙げた10のポイントを理解し慎重に用いれば、 医療の質向上や業務効率化に貢献し得る。 しかし、 リスク管理を怠れば医療安全を損なう危険性もある。

AIは人間の判断を補助するものであり、 最終的な意思決定と責任は人間が担う。 技術の進歩に合わせ、 継続的な情報収集と学習が重要である。

次回以降では、 実際の臨床応用と結びつけ、 具体的なプロンプト例などを解説する。

大塚先生執筆の書籍はこちら!

医師による医師のためのChatGPT入門

臨床・研究を変える究極のプロンプト500選

2025年4月発刊!医療現場でそのまま使えるプロンプトをテーマ別に収載。 日々の診療・教育・研究に役立つ実践的な1冊。

医師による医師のためのChatGPT入門

臨床がはかどる魔法のプロンプト

ChatGPTに苦手意識のある医師に向け、 基本的な使い方から日常業務での活用法までを、 会話形式で丁寧に解説。

医師による医師のためのChatGPT入門 2

臨床現場ががらりと変わる生成AI実践術

GeminiやClaudeなどの登場で広がる最新の活用法を網羅。 前作に続き、 実例とともに理解が深まる構成。

編集・作図:編集部、 監修:所属専門医師。各領域の第一線の専門医が複数在籍。最新トピックに関する独自記事を配信中。

編集・作図:編集部、 監修:所属専門医師。各領域の第一線の専門医が複数在籍。最新トピックに関する独自記事を配信中。