HOKUTO編集部

8ヶ月前

【NEJM】「AIに頼りすぎ」 を防ぐには? 臨床でAIを活かす指導のコツ

生成AIの医療活用におけるトップランナー、 大塚篤司先生による新連載です。 今回は、 LLMを指導に活用する際の安全な使い方を整理したNEJMの総説を取り上げます。 知っておくべき 「便利だけど危険」 なAIとの付き合い方を見ていきましょう。

今回のトピックはこちら!

トピックの概要

医療教育でのChatGPTなど大規模言語モデル (LLM) の使い方を整理したNEJMの総説です¹⁾。 LLMは臨床現場でも活用できますが、 その回答がどこから来たのかわからず、 間違いも含まれます。

この 「便利だけど危険」 という特性を理解して、 現場でAIを教育に活かすための 「DEFT‑AI」 という指導法を本論文では提案しています。 指導医が研修医のAI使用を見守りながら、 正しい判断力を育てる方法を具体的に示した内容です。

Dr.大塚の注目ポイント

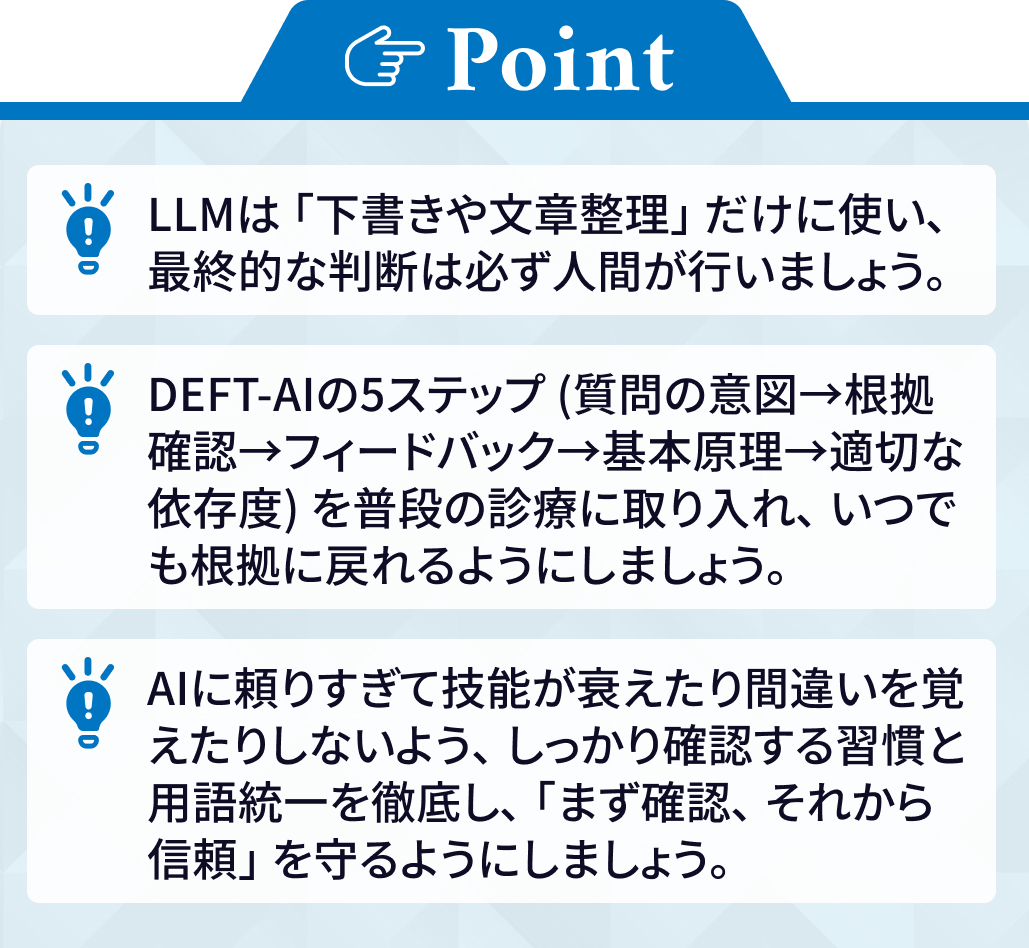

1. AI依存のリスク認識

LLMは人間のような自然な文章で答えてくれるので、 つい信頼してしまいがちです。 しかし頼りすぎると、 自分で考える力が衰えてしまいます。 特に若手医師は、 本来身につけるべきスキルを覚えなかったり (never‑skilling)、 既に持っているスキルが錆びついたり (deskilling)、 AIの間違った情報を覚えてしまったり (mis‑skilling) する危険があります。 だからこそ指導医の見守りが必要です。

2. DEFT‑AIフレームワークの活用

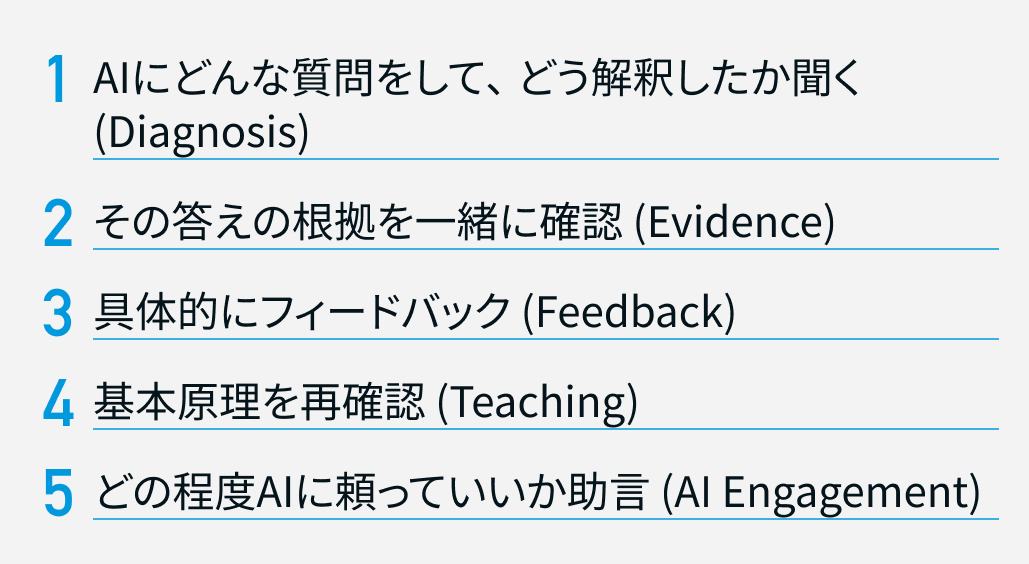

研修医がAIを使用する際の指導方法として、 5つのステップからなる 「DEFT‑AI」 が提案されています。

DEFT‑AI

この流れを普段の診療に取り入れることで、 研修医はAIを 「人間の代わり」 ではなく 「人間の助手」 として使えるようになります。

3. 協働スタイルの使い分け

AIとの付き合い方には2つのパターンがあります。 重要な診断や治療方針を決めるときは 「ケンタウル型」 で、 人間が最終判断を下し、 AIには選択肢を並べてもらったり要点を整理してもらったりする程度にとどめます。

一方、 定型的な書類作成や情報整理では 「サイボーグ型」 で、 AIと一緒に作業して効率を上げます。 どちらの場合も 「まず確認、 それから信頼」 を心がけ、 必ず根拠を確かめる習慣をつけることが大切です。

4. 実装への具体的アプローチ

実際の現場では、 救急外来での鑑別診断のブレインストーミング、 入院サマリーの下書き作成、 患者さんへの説明文の調整など、 あまり創造性を必要としない作業でLLMを活用すると時間短縮になります。 ただし、 病院内で使う用語や略語を統一したリストを作ったり、 「この文書はAIを使って作成しました」 という表示をテンプレート化したりして、 間違いを防ぐ仕組みも同時に整えることが重要です。

明日から始める実践ステップ

次の当直からすぐに始められる簡単な方法を提案します。

研修医がAIを使ったときは、 ① 「何を聞きたくてAIに質問したの?」 を一言で説明してもらい、 ②AIの答えの根拠を最低1つPubMedで一緒に確認し、 ③気づいた修正点を3つ口頭で伝えてください。 特別な研修会を開く必要はありません。 普段の診療の中で、 この3ステップを繰り返すだけで十分です。

AIは作業を早くしてくれますが、 早いだけでは医療の質は上がりません。 「何を聞いて→根拠は何で→どこを直すか」 という流れに指導医の目を通すことが、 AI時代の医療教育を良い方向に進める第一歩です。

<出典>

1) N Engl J Med. 2025 Aug 21;393(8):786-797.

※X (旧Twitter) の利用規約に基づき、 サブライセンスが認められている埋め込み形式でTweetを紹介しています。 掲載停止のご希望がある場合は、 XのHOKUTO公式アカウント (@HOKUTOmed) までDMでご連絡をお願いします。

大塚先生執筆の書籍はこちら!

医師による医師のためのChatGPT入門

あっという間のAIスライド作成術

2025年8月発刊! 「スライドづくりの時間が足りない」 を一瞬で解決。 各種生成AIを場面別に使い分け、 構成やデザインをあっという間に整える実践書。 「伝える」 スライド作成のテクニックも公開!

医師による医師のためのChatGPT入門

臨床・研究を変える究極のプロンプト500選

2025年4月発刊!医療現場でそのまま使えるプロンプトをテーマ別に収載。 日々の診療・教育・研究に役立つ実践的な1冊。

医師による医師のためのChatGPT入門

臨床がはかどる魔法のプロンプト

ChatGPTに苦手意識のある医師に向け、 基本的な使い方から日常業務での活用法までを、 会話形式で丁寧に解説。

医師による医師のためのChatGPT入門 2

臨床現場ががらりと変わる生成AI実践術

GeminiやClaudeなどの登場で広がる最新の活用法を網羅。 前作に続き、 実例とともに理解が深まる構成。

皮膚科の診断に迷ったらChatGPTに全部聞いちゃえ!

紅斑・丘疹・鱗屑など皮疹の"見え方"を言語化し、 ChatGPTで鑑別リストを引き出す手順を症例対話で丁寧に指南。

編集・作図:編集部、 監修:所属専門医師。各領域の第一線の専門医が複数在籍。最新トピックに関する独自記事を配信中。

編集・作図:編集部、 監修:所属専門医師。各領域の第一線の専門医が複数在籍。最新トピックに関する独自記事を配信中。